彭博社报道,美国右翼电台主持人和国会议员声称,他们在ChatGPT这个AI聊天机器人的回答中看到了左翼自由派偏见的迹象,这令人担忧。

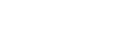

当地时间2月7日,微软公司首席执行官萨蒂亚·纳德拉宣布将人工智能聊天机器人ChatGPT整合到必应搜索引擎中,这也开启了硅谷的“全新科技竞赛”。越来越多的美国科技界人士相信,引入AI机器人的新式网络搜索不会产生一连串的蓝色链接(即普通搜索生成的链接)和广告列表,而是由ChatGPT等人工智能程序生成更接近人类的回答。

许多人惊叹于这项技术的威力,但美国的右翼评论员们却明显不以为然。他们一直在挖掘系统硬编码中内嵌的、他们认为具有危害性的自由主义思想倾向的证据。

比如:为什么ChatGPT愿意赞扬前CNN主播布莱恩·斯特尔特( Brian Stelter),而不赞扬保守派专家本·夏皮罗(Ben Shapiro)?为什么它自信地说儿童可以是变性人,这显然是对右翼反变性人权利运动的一种侮辱?为什么它被编程为避免使用N字(对黑人的歧视用语)?

对网上保守派所称的“GPT觉醒运动”的反击,正在右翼电台甚至国会议员中显现出来。例如,德克萨斯州的参议员特德·克鲁兹呼吁关注保守派的抱怨,即ChatGPT拒绝写一首赞美他的歌曲,但它却为古巴第一任最高领导人菲德尔·卡斯特罗这么做了。

2月初,ChatGPT研发公司OpenAI的首席执行官山姆·阿尔特曼抱怨说,他的员工一直有收到来自不满用户的仇恨邮件。阿尔特曼承认ChatGPT具有某些“带有偏见的缺陷”,但他向批评者保证,他的公司正在“努力改进默认设置,使输出的内容更加中立”。

如果人工智能文化战争听起来很熟悉,那是因为它本质上是2016年首次出现在社交媒体上的针对左翼偏见内容展开的辩论的延伸。由塔克·卡尔森(Tucker Carlson)等媒体人物,和克鲁兹及特朗普等公职人员煽动的这些不满情绪,是马斯克决定收购推特的一个主要因素,他把这笔财务上可疑的交易,说成是为了从“苏醒的思想病毒”中拯救人类文明。

马斯克对ChatGPT提出了批评,这与他对被收购之前的推特的抱怨相呼应。对于一条嘲笑ChatGPT政策的推文:“在道德上永远不能接受使用种族歧视的诋毁”,马斯克回复:“这令人担忧。”

值得指出的是,很多针对硅谷存在政治偏见的攻击本身就不怀好意。左翼评论家对社交媒体公司过滤内容的方式有自己的一套抱怨模式,而且有很多证据表明,社交媒体的算法有时会偏向保守派的观点。

根据公司内部指标,夏皮罗的播客等右翼评论在Facebook上的表现通常优于主流和左翼媒体。在社交媒体之外,人工智能系统多次被证明会产生曲解事实的结果,加剧执法等领域长期存在的种族差异。

此次新推出的AI聊天机器人拒绝使用污言秽语,但也表现出愿意宣传右翼传播的错误信息,例如认为佛罗里达州帕克兰的校园枪击事件是由“危机演员”(演习训练中扮演灾难受害者的表演人员)策划的错误观点。

社交媒体的文化战争确实说明,纳德拉和阿尔特曼要处理ChatGPT收到的投诉会有多困难。机器学习算法无法告知得出特定结果的原因,比如那些为Facebook提供新闻源、为ChatGPT提供内容的算法。这就为活动家提供了机会,可以将错误或笨拙的机器人反馈视为应用存在偏见的证据。

如果真的存在这种证据的话,这意味着现代人工智能聊天机器人比之前的产品更加不透明,允许任何人通过自己的政治视角来解释他们不愿意接受的结果。

错误是不可避免的,因为大型语言模型不具备固有真理感。ChatGPT在遇到它无法回答的问题时,倾向于简单地编造一些东西。这种“幻觉”式的回复可以变得非常具有说服力,这也是人工智能专家所提及的问题。

去年,Meta撤下了一个被称为Galactica的大型语言模型,此模型本应是“人类科学知识的精选语料库”,但批评者指出它倾向于在诸如”吃碎玻璃的好处”等查询背后编造科学知识。

微软的新版必应通过在AI生成答案中加入引文列表(基本上是传统链接)来提高透明度。必应网站还提出警示语,提醒用户他们可能“看到或听到令人信服但不完整、不准确或不适当的回答”。

谷歌在2月8日展示自己的搜索聊天机器人时,提供了这些隐患的一手证据。这项新服务名为Bard,在回答有关詹姆斯·韦伯太空望远镜的询问时,谎称此望远镜已经拍摄到了第一颗系外行星。谷歌的股票在当天下跌7%,是几个月来的最大跌幅。

谷歌的一份声明将引入Bard的搜索引擎描述为仍在进行中的工作,并表示回答错误“突出了严格测试过程的重要性”。近期记录表明,谷歌可能需要的不仅仅是技术上的严格,它还需要政治上的精明。